5 najczęstszych błędów w SEO i co z nimi zrobić

Cześć! W dzisiejszym odcinku porozmawiamy o 5 najczęstszych błędach pod kątem SEO, z którymi spotykam się na stronach internetowych oraz o tym, co można z nimi zrobić. Zaczynamy!

META TAGI

Problemy z meta tagami i niewykorzystywanie ich potencjału w SEO i nie tylko to niewątpliwie jeden z najczęstszych błędów, z którymi się spotykam. Ale co to są te meta tagi? To po prostu znaczniki HTML wykorzystywane w części nagłówkowej dokumentu służące do opisu pewnych parametrów w kodzie strony internetowej. Istnieją różnego rodzaju meta tagi, służące do określenia różnego rodzaju parametrów a część z nich ma wpływ na SEO.

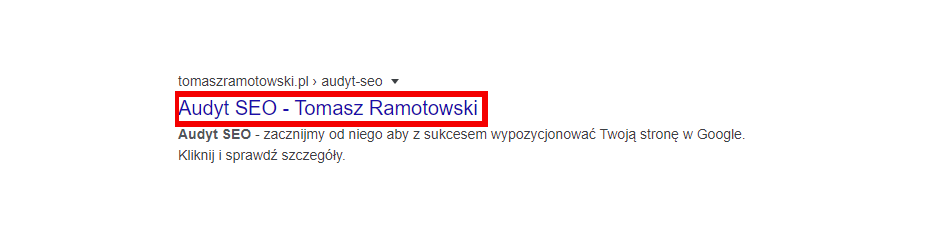

Jednym z najistotniejszych meta tagów mających wpływ na pozycjonowanie jest tag określający tytuł danej podstrony, czyli <title>. Tytuł to jeden z elementów widocznych w wynikach wyszukiwania. To w nim określamy i pokazujemy internautom, jakich treści mogą się spodziewać po kliknięciu w link i przejściu na daną stronę. Jest mocno wyeksponowany i niewątpliwie jako pierwszy rzuca się w oczy.

Tytuł to dla robotów Google jeden z sygnałów czego dotyczy dana podstrona. To doskonałe miejsce na umieszczenie głównego słowa kluczowego (lub kilku głównych), które chcemy dla tej podstrony pozycjonować. Sama optymalizacja tytułów niejednokrotnie spowodowała wyrwanie strony z odmętów wyszukiwarki i wyświetlanie jej na znacznie lepszych pozycjach.

Jeżeli chodzi o aspekty techniczne, to Google kieruje się nie ilością znaków a szerokością w pikselach. Tytuł, jeżeli ma być wyeksponowany i widoczny w całości nie może przekraczać 600px szerokości. W przeciwnym razie zostanie skrócony. Warto pamiętać, że duże i rozłożyste litery jak np. litera W zajmuje dużo więcej miejsca niż litera I. Z punktu widzenia SEO nie zawsze musimy trzymać się tych 600px i możemy dopuścić do sytuacji, w której tytuł zostaje ucięty, ale nie samym SEO człowiek żyje. Jeżeli chcesz, aby cały komunikat był widoczny, trzymaj się 600px. Jeżeli nie… to nie 🙂

Dla SEO ważne jest również, aby każda podstrona miała swój dedykowany, niepowtarzalny tytuł. Nie dopuszczaj do sytuacji, w której różne podstrony mają te same tytuły. Jeżeli jakaś treść jest podzielona na części lub mówimy o kolejnych podstronach danej kategorii w sklepie internetowym, to dodawaj na końcu do tytułu np. informację o stronie, na której się znajdujesz, np. Kaskex (jako nazwa firmy) – kaski do rowerów – strona 2.

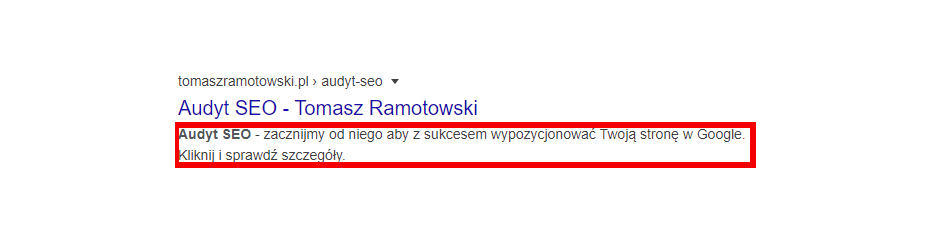

Kolejnym meta tagiem, który teoretycznie nie ma wpływu na SEO, ale muszę o nim wspomnieć, jest tag description, odpowiadający za opis, który pojawia się w wynikach wyszukiwania pod tytułem. Description od paru ładnych lat nie ma bezpośredniego przełożenia na pozycje strony w wyszukiwarce Google, ale jest widoczny w wynikach, internauci je czytają i ich jakość wpływa na CTR, czyli ilość kliknięć w link. Dobrą praktyką jest tworzenie atrakcyjnych opisów, które przykuwają uwagę i zachęcą odbiorców do wejścia na stronę. Zgodnie z zasadą wyróżnij się albo zgiń, niektórzy stosują różne rozwiązania, takie jak emotki czy inne znaki specjalne. Zarówno w opisach, jak i tytułach. Wszystko po to, aby zwrócić uwagę i wyróżnić swoją stronę na tle konkurencji. Czasami, pomimo że strona jest niżej w wynikach od konkurencji, atrakcyjny i rzucający się w oczy opis powoduje, że zgarnia więcej kliknięć.

Podobnie jak w przypadku tytułów warto zadbać o unikalne opisy dla każdej podstrony. Musisz jednak mieć na uwadze, że Google czasami nie wyświetli Twojego opisu, nawet jeżeli go dodałeś. Zamiast tego wyświetli wybrane przez siebie fragmenty Twojej podstrony, jeżeli uzna, że ten tekst lepiej pasuje do danego zapytania użytkownika. Google obcina opisy po przekroczeniu ok. 155 – 160 znaków.

Kolejnym ważnym meta tagiem jest tag robots, dedykowany bezpośrednio wyszukiwarkom. Informuje on je o ich uprawnieniach do odwiedzania i indeksowania strony. Domyślnie przyjmuje dyrektywy index, follow, czyli zakłada, że robot Google może swobodnie poruszać się po stronie i ją indeksować. Jeżeli nie chcemy tego zmieniać, to nie musimy go w ogóle dodawać na stronie. Ale jeżeli sytuacja tego wymaga i chcemy np. zablokować daną podstronę przed pojawieniem się w wyszukiwarce, bo np. pracujemy nad nową wersją serwisu i nie chcemy go indeksować, lub dbamy o crawl budget, możemy stosować różne kombinacje tagu robots. Więcej informacji o indeksowaniu stron i crawl budget.

Mamy tak:

-> index – wartość domyślna, która zezwala na indeksowanie,

-> noindex – nie pozwala na indeksowanie danej podstrony,

-> follow – wartość domyślna, która pozwala robotom podążać za odnośnikami zawartymi na stronie,

-> nofollow – przeciwieństwo a więc zabraniamy robotom podążać za linkami.

Istnieją również inne dyrektywy dla tagu robots, ale te są niewątpliwie najważniejsze. Jeżeli mocniej interesuje Cię ten temat, to tutaj znajdziesz link do instrukcji wyszukiwarki Google w tym zakresie.

OPTYMALIZACJA STRONY

Kolejnym bardzo częstym błędem, w którym brak wykorzystywania możliwości meta tagów niejako się zawiera, jest brak jakiejkolwiek nawet w podstawowym zakresie, optymalizacji strony pod kątem wyszukiwarek. Wiadomo, od optymalizacji są fachowcy – pozycjonerzy stron, nierzadko programiści tworzący stronę posiadają chociaż podstawową wiedzę w temacie. Niestety często strony powstają bez zadbania o aspekty SEO i potem właściciele tych stron nic z tym nie robią. Oczywiście, jeżeli traktujesz swoją stronę jedynie jako wizytówkę i coś, co musi po prostu istnieć, ale niekoniecznie ktoś ma tam w ogóle trafić, to nie ma problemu, ale myślę, że większość stron powstaje po to, aby klienci mogli z nich skorzystać. Zatem brak optymalizacji nawet w tym podstawowym zakresie to duży błąd.

Co mam na myśli mówiąc o podstawowym zakresie, to na pewno:

-> zadbanie o meta tagi i ich poprawność,

-> przyjazne adresy URL,

-> nagłówki H1, H2 itd.,

-> poprawna struktura treści na stronie,

-> pojawiające się słowa kluczowe w treściach,

-> założenie konta w Google Search Console i przesłanie mapy witryny,

-> zadbanie o szybkie ładowanie strony.

Czasami spotykam się również z innym zjawiskiem, o którym wspomnę – przeoptymalizowaniem strony, czyli przesadą w drugą stronę. Najczęściej objawia się to mocnym zagęszczeniem słów kluczowych nawet do tego stopnia, że teksty są kompletnie nieczytelne i odpychające dla użytkownika, chowaniem słów kluczowych gdzieś po kątach itd. W obecnych realiach to raczej zaszkodzi niż pomoże (poza pewnymi wyjątkami).

TE SAME TREŚCI POD WIELOMA ADRESAMI URL

Te same treści pod wieloma adresami URL – mam tutaj na myśli wersję adresu z przedrostkiem www, bez www, http, https itd. Musisz wiedzieć i pamiętać, że dla Google wersja z www i bez www to dwie różne strony. Gdy dopuszczasz do sytuacji, w której Twoja strona jest dostępna pod wieloma adresami, tworzy się problem związany z duplikacją treści, o czym opowiem więcej za chwilę. Twoim zadaniem jest zapamiętać i robić tak, aby dana treść była dostępna pod jednym adresem URL. Najłatwiejszym rozwiązaniem w przypadku problemów z www i bez www jest zastosowanie przekierowań, tzw. przekierowanie 301. Gdy zdecydujesz, że adres Twojej strony ma zawierać przedrostek z www i przyjąć, np. postać „https://www.twojastrona.pl” to pozostałe opcje, czyli https://twojastrona.pl” czy „http://twojastrona.pl” należy przekierować tak, aby po wpisaniu przez użytkownika w przeglądarce wersji, która Cię nie interesuje, dochodziło do automatycznego przekierowania na wersję poprawną. Wykorzystuje się do tego przekierowanie 301, które jest sygnałem dla robotów Google, że treść znajduje się pod innym adresem i roboty również automatycznie za nim podążą. Czasami strona jest dostępna pod jeszcze większą ilością adresów URL, np. z „index.html” czy „index.php” na końcu adresu. Na takie przypadki również musisz uważać.

POWIELANIE TREŚCI

Nawet jeżeli zadbasz o to, aby adres Twojej strony był dostępny wyłącznie pod jedną wersją i tak może dochodzić do duplikowania treści i wyświetlania tych samych tekstów pod różnymi adresami URL. Np. w sklepach internetowych dane produkty występują w różnych wariantach cenowych, czy kolorystycznych i wszystkie zawierają te same opisy albo w wyniku sortowania produktów tworzą się setki podstron z tą samą zawartością.

Duplikowanie treści, czyli tzw. duplicate content to problem z punktu widzenia SEO. Google nie lubi takich treści i może potraktować je jako bezużyteczne i niechętnie pokazywać użytkownikom w wynikach wyszukiwania. Po drugie, w przypadku dużych serwisów pojawia się problem z budżetem indeksowania. Istnieją setki czy nawet tysiące podstron, na których roboty Google tracą czas, zamiast zająć się ważnymi podstronami.

Rozwiązania na tego typu problemy są różne. Możemy stosować przekierowania 301, o których już wspominałem, możemy stosować tag kanoniczny, aby wskazać robotom gdzie jest treść nadrzędna i główna, możemy całkowicie eliminować indeksację takich adresów, np. poprzez tag noindex. Ale tutaj ważna uwaga, tego typu operacje należy przemyśleć każdorazowo dla konkretnego przypadku. Czasami opłaca się wyłączyć pewne podstrony z indeksacji, czasami nie. Zalecam skonsultować się ze specjalistą przed podjęciem takiej decyzji. Na pewno warto pochylić się nad problemem duplikacji treści w obrębie swojej strony internetowej.

THIN CONTENT – TREŚCI O NISKIEJ JAKOŚCI

Thin content to po prostu treści niskiej jakości – np. bardzo krótkie teksty, takie zawierające błędy gramatyczne, z wieloma powtórzeniami, bezsensowne mieszaniny słów czy automatycznie generowane treści. Są one zazwyczaj nieatrakcyjne i nieprzyjemne w czytaniu. Zarówno dla Google, jak i dla użytkowników strony o niskiej wartości treści i braku unikalności są po prostu nieatrakcyjne. A to może przyczynić się do spadku widoczności w wyszukiwarce. Co z tym zrobić? Jeżeli możesz, rozbuduj treści na podstronach, które podejrzewasz, że mogą być dla robotów indeksujących nieatrakcyjne. Jeżeli nie możesz, zastanów się, czy nie lepiej będzie zablokować je przed robotami w ogóle. Użytkownicy, jeżeli to ważne, dalej będą mieli do nich dostęp (np. poprzez strukturę strony), a roboty będą takie strony pomijać i nie obniży to rankingu Twojej witryny.

Ok, na dzisiaj to już wszystko. Omówiliśmy najczęściej pojawiające się problemy w SEO oraz to jak je rozwiązać. Po dzisiejszym materiale już wiesz, że trzeba zadbać o optymalizację strony, zwrócić szczególną uwagę na meta tagi, duplikowanie treści czy thin content. Mam nadzieję, że odcinek Ci się podobał. Jeżeli tak to zostaw łapkę w górę i zasubskrybuj kanał, żeby być na bieżąco z nowymi materiałami i żeby zmobilizować mnie do dalszego nagrywania, a co 🙂 Mam nadzieję, że do zobaczenia w następnym odcinku!